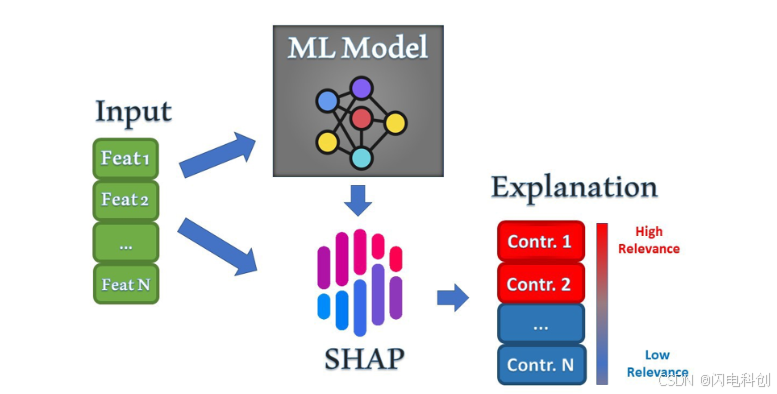

SHAP(SHapley Additive exPlanations)是基于博弈论的模型可解释性方法,旨在通过为机器学习模型的预测结果提供透明的、可理解的解释。SHAP方法的核心思想是借用Shapley值,它最早出现在合作博弈论中,由Lloyd Shapley提出,旨在量化每个玩家(特征)对合作结果的贡献。在机器学习中,Shapley值被用来评估每个输入特征对模型输出的贡献,从而为模型的决策过程提供解释。

1. Shapley值的基本原理

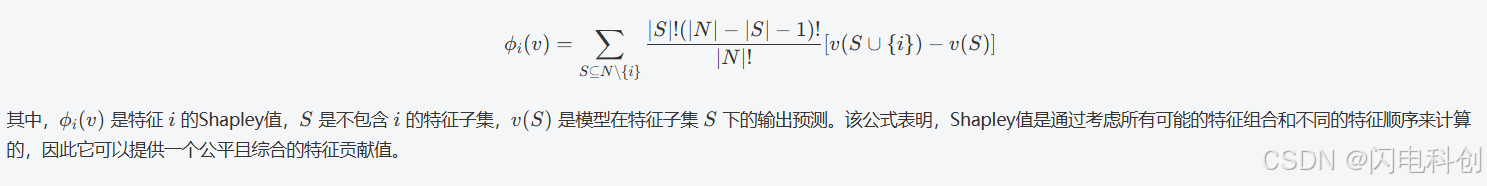

Shapley值源自博弈论,假设一组玩家共同合作并分享利润,Shapley值则为每个玩家分配一个公平的利润份额。具体而言,Shapley值衡量的是每个玩家(特征)在所有可能的合作顺序中,对总利润(模型输出)的贡献。具体计算时,考虑所有可能的特征排列组合,计算某个特征加入当前模型时对预测结果的边际贡献,最后对这些贡献值进行加权平均。对于每个特征的Shapley值来说,其计算方式是:

2. SHAP值的优点

- 公平性:Shapley值具备从博弈论中继承的公平性,能够公平地分配每个特征对预测的贡献。在所有可能的分配方法中,Shapley值具有最优的公平性属性。

- 一致性:SHAP值具有一致性,即如果一个特征对模型预测的贡献增加,SHAP值也会相应增加。这确保了模型的解释在不同情况下具有一致性。

- 可加性:SHAP值符合可加性原则,即多个特征对预测的贡献值之和等于模型的总体输出预测。这使得我们可以在多特征模型中分解出每个特征对预测结果的贡献。

3. SHAP的实现方法

SHAP的实现方式主要有两种:准确计算Shapley值的原生方法和近似计算的技术。

- 精确Shapley值计算:直接应用博弈论中的Shapley值公式,计算所有可能的特征排列组合,这种方法适用于小规模数据集,但计算量极大,因此在实际应用中不常使用。

- 近似Shapley值计算:为了应对大规模数据集和复杂模型,通常采用近似方法来计算Shapley值,如LIME、TreeSHAP等。TreeSHAP是一种专门针对树模型(如XGBoost、LightGBM)的高效近似方法,能够显著提高计算效率。它通过利用树模型的结构化特点,快速计算每个特征的Shapley值。

4. SHAP的应用场景

- 模型透明度:SHAP能够为复杂的黑箱模型(如深度学习、梯度提升树等)提供可解释性,帮助用户理解模型的决策过程,增强对模型的信任。

- 特征重要性分析:通过计算每个特征的Shapley值,SHAP能够评估不同特征对模型预测的贡献,从而帮助开发者进行特征选择、模型优化。

- 模型诊断与公平性检查:SHAP的可解释性也能够帮助发现模型的潜在偏差,尤其是在面对敏感特征(如性别、年龄、种族等)时,SHAP能够帮助识别模型在这些特征上的偏见,进而进行相应的修正。

5. SHAP与其他可解释性方法的对比

与传统的可解释性方法(如LIME)相比,SHAP的优点在于它具备更高的理论基础和公正性,能够提供全局和局部的解释。然而,SHAP的计算开销相对较大,尤其在面对大量特征时,精确计算可能变得不可行。因此,SHAP更适用于在可计算范围内的高性能模型和少量特征的数据集。相比之下,LIME等方法通过局部线性模型的拟合来提供可解释性,计算更为高效,但其解释的公平性和一致性较差。

6. 总结

SHAP是一种基于博弈论的强大可解释性工具,能够为复杂模型提供透明的、细粒度的解释。通过计算Shapley值,SHAP能够公平地量化每个特征对模型预测的贡献,从而为机器学习模型的理解、优化和公平性检查提供重要支持。尽管计算复杂度较高,但通过近似方法,如TreeSHAP,SHAP已经能够在实践中得到广泛应用。