DAY 48 随机函数与广播机制

知识点回顾:

- 随机张量的生成:torch.randn函数

- 卷积和池化的计算公式(可以不掌握,会自动计算的)

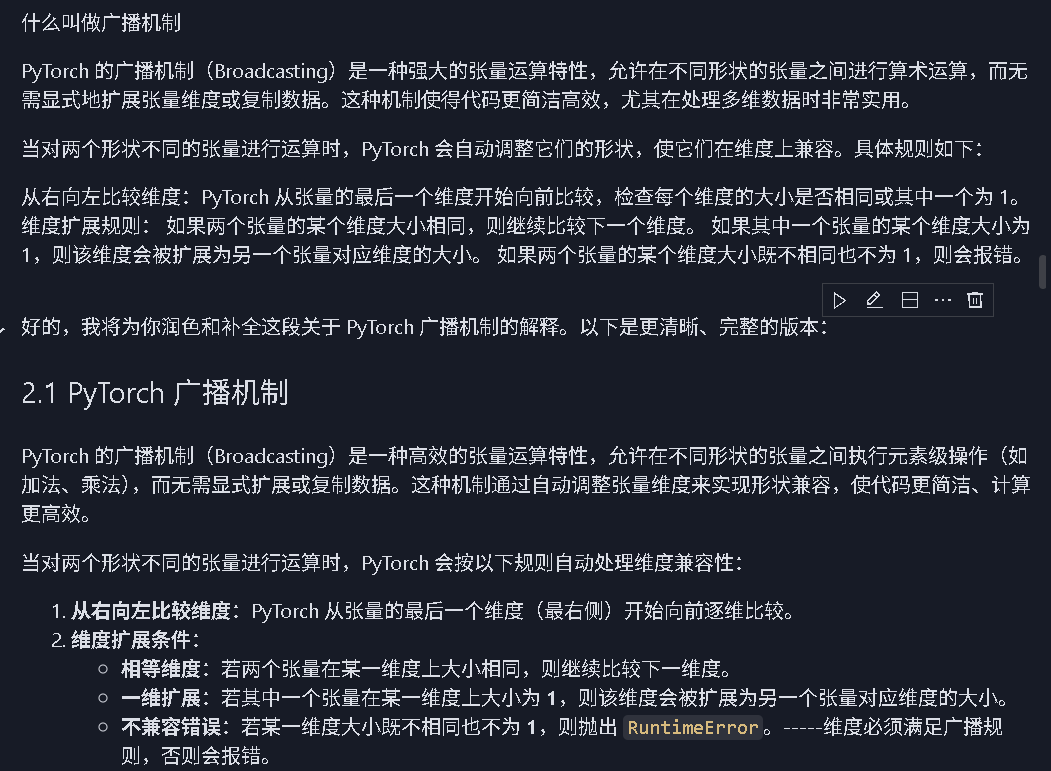

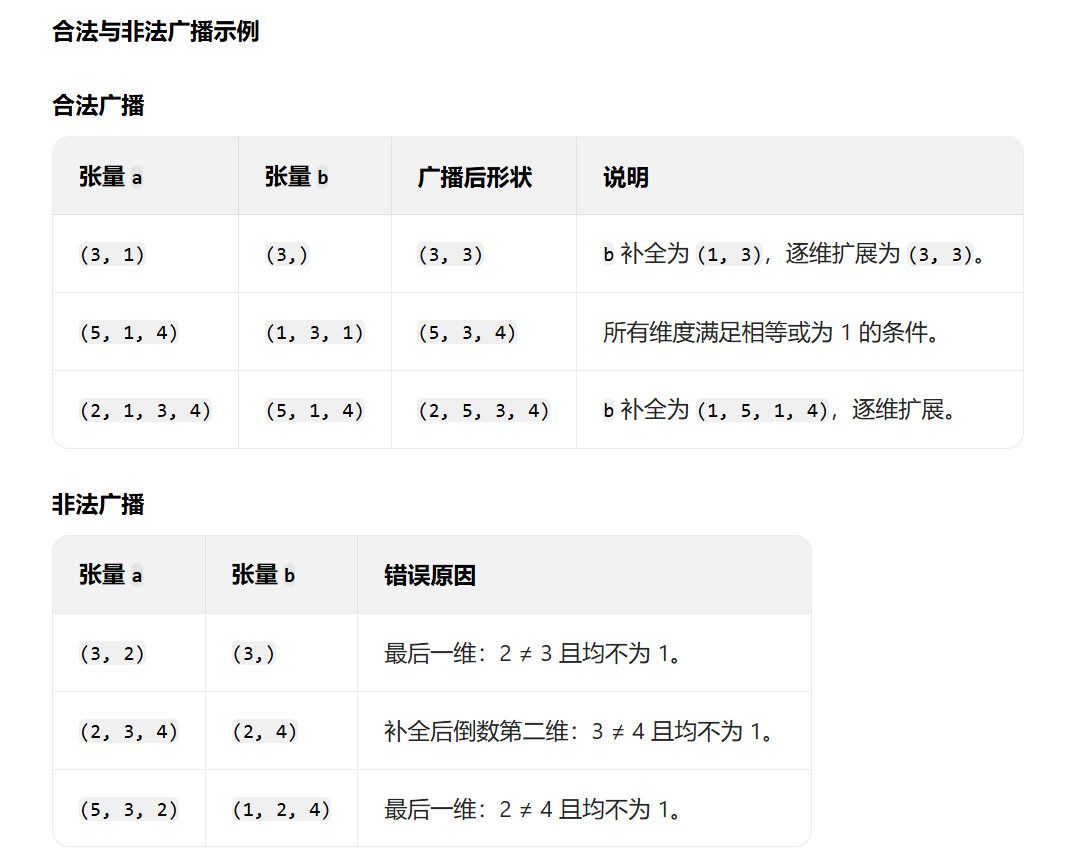

- pytorch的广播机制:加法和乘法的广播机制

ps:numpy运算也有类似的广播机制,基本一致

作业:自己多借助ai举几个例子帮助自己理解即可

import torch

import torch.nn as nn# 生成输入张量 (批量大小, 通道数, 高度, 宽度)

input_tensor = torch.randn(1, 3, 32, 32) # 例如CIFAR-10图像

print(f"输入尺寸: {input_tensor.shape}") # 输出: [1, 3, 32, 32]# 定义卷积层

conv_layer = nn.Conv2d(in_channels=3, out_channels=64, kernel_size=3, stride=1, padding=1) # 示例参数

print(f"卷积层参数: {conv_layer}") # 输出: 卷积层的参数# 前向传播

output_tensor = conv_layer(input_tensor) # 卷积操作

print(f"卷积后尺寸: {output_tensor.shape}") # 输出: [1, 64, 32, 32]# 2. 池化层操作 (减小空间尺寸)

pool = nn.MaxPool2d(kernel_size=2, stride=2) # 创建一个最大池化层

pool_output = pool(output_tensor)

print(f"池化后尺寸: {pool_output.shape}") # 输出: [1, 64, 16, 16]# 3. 将多维张量展平为向量

flattened = pool_output.view(pool_output.size(0), -1)

print(f"展平后尺寸: {flattened.shape}") # 输出: [1, 64 * 16 * 16] = [1, 16384]# 4. 线性层操作

fc1 = nn.Linear(in_features=16384, # 输入特征数out_features=128 # 输出特征数

)

fc_output = fc1(flattened)

print(f"线性层后尺寸: {fc_output.shape}") # 输出: [1, 128]# 5. 再经过一个线性层(例如分类器)

fc2 = nn.Linear(128, 10) # 假设是10分类问题

final_output = fc2(fc_output)

print(f"最终输出尺寸: {final_output.shape}") # 输出: [1, 10]

print(final_output)# 使用Softmax替代Sigmoid

softmax = nn.Softmax(dim=1) # 在类别维度上进行Softmax

class_probs = softmax(final_output)

print(f"Softmax输出: {class_probs}") # 总和为1的概率分布

print(f"Softmax输出总和: {class_probs.sum():.4f}")

浙大疏锦行-CSDN博客