罗列ollma镜像

ollama list

拉取ollama镜像源里面的模型:

ollama pull qwen2:1.5b

下载CudaToolkit

https://developer.nvidia.com/cuda-toolkit-archive

我这里选择11.7的万金油版本,从来没出过bug

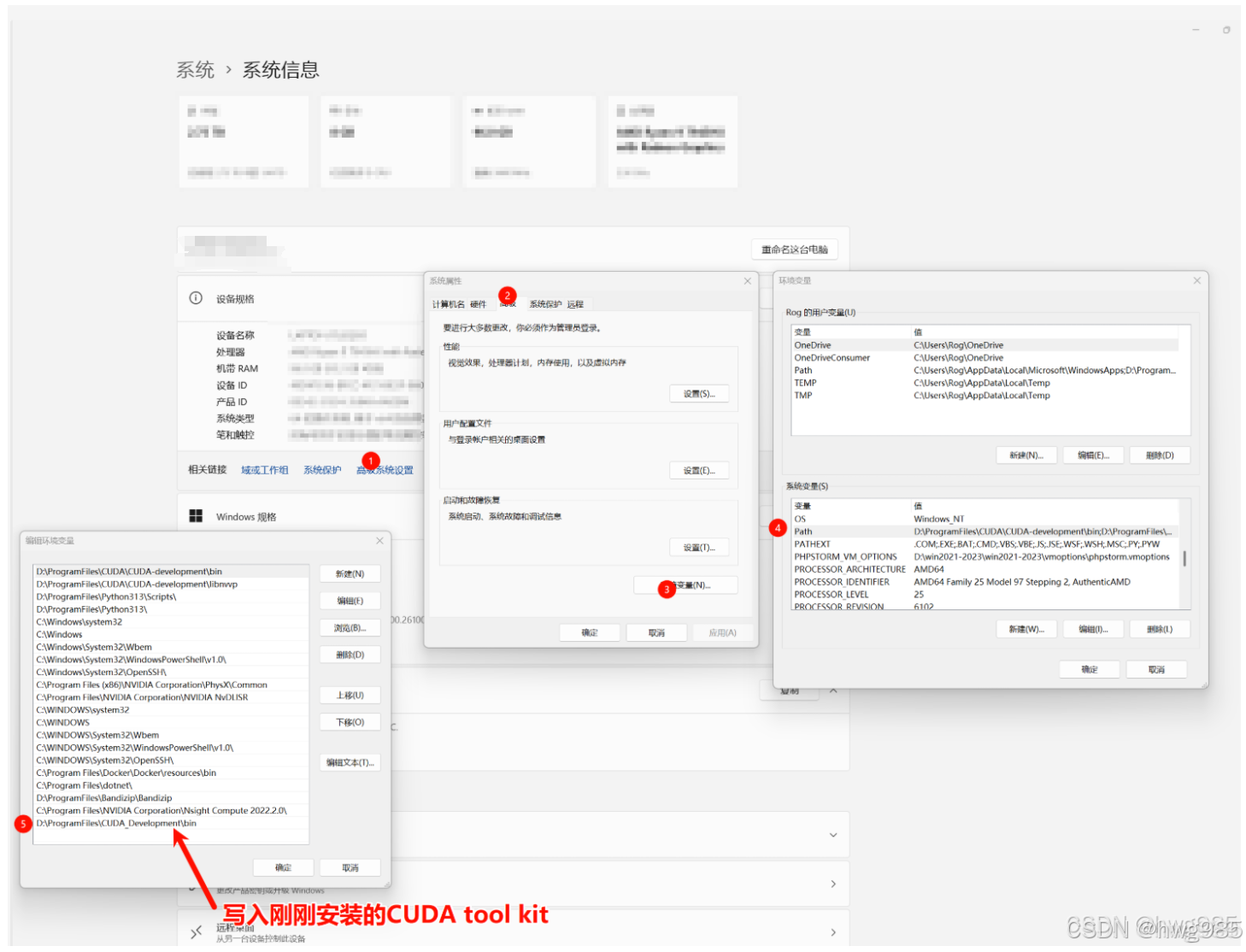

Ollama安装好后,为了让推理跑在GPU上,可以按照如下步骤 设置环境变量:

在“系统变量”中,点击“新建”按钮。

添加以下环境变量:

变量名:OLLAMA_GPU_LAYER

变量值:cuda

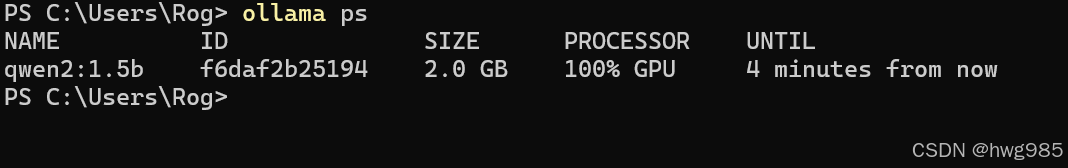

验证是否使用gpu

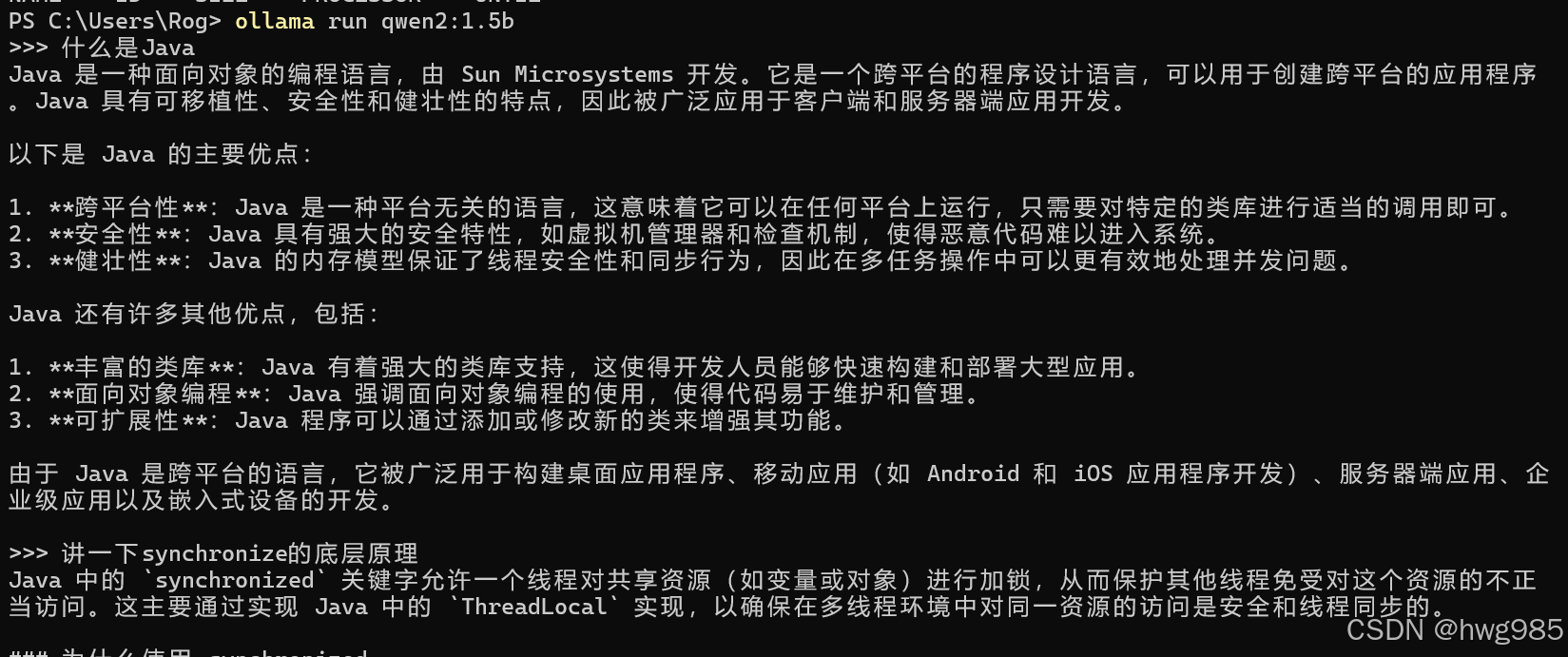

问几个比较复杂的问题然后再另外一个命令行窗口输入命令

ollama ps

窗口1

窗口2

可以看见,我们使用到了gpu,并且很神速

或者看一下任务管理器的gpu运行情况也行,如果利用率很高说明用到了gpu