DeepSeek-Prover-V2-671B最新体验地址:Prover版仅适合解决专业数学证明问题

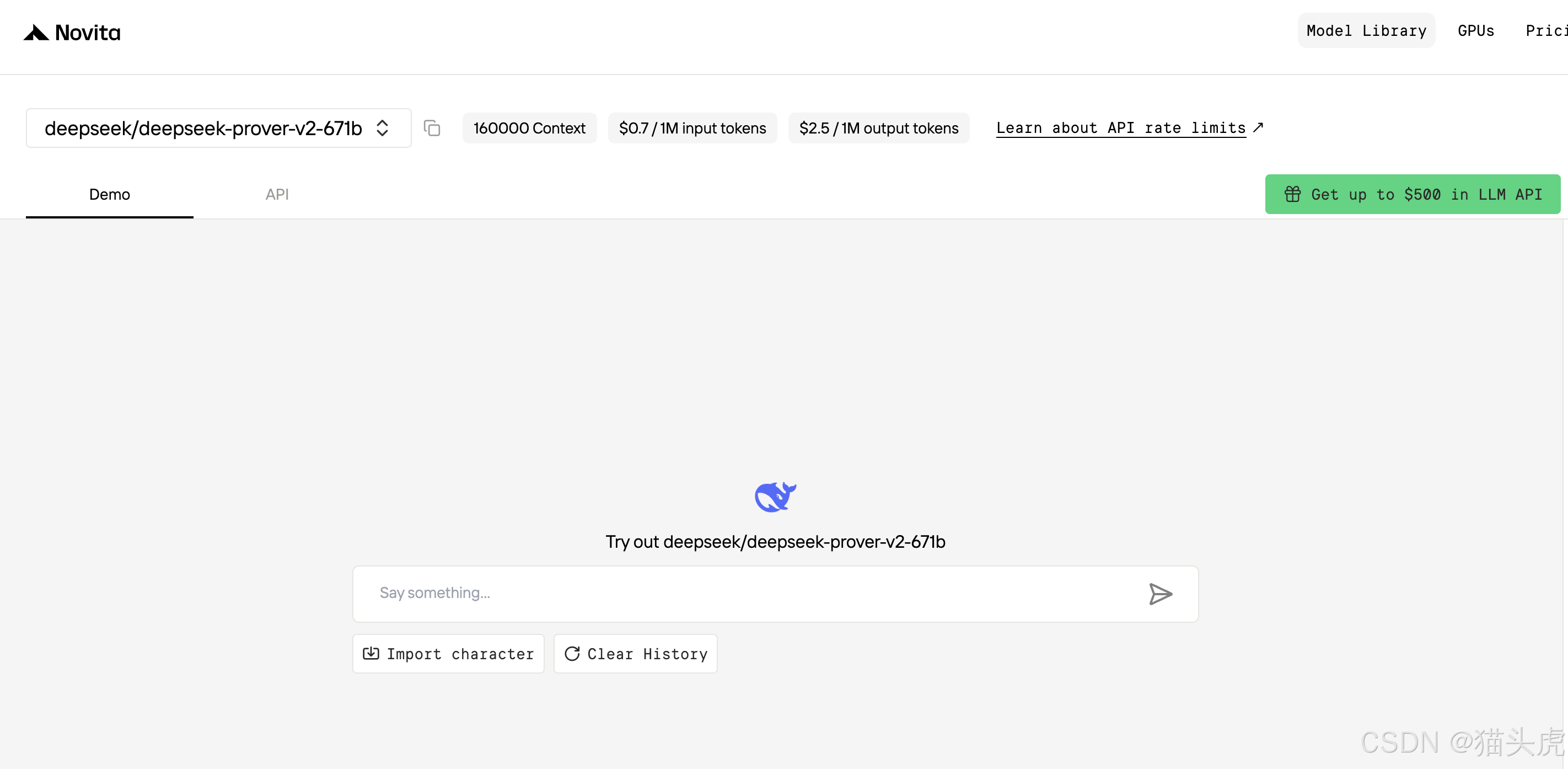

DeepSeek 团队于 2025 年 4 月 30 日正式在Hugging Face开源了其重量级新作 —— DeepSeek-Prover-V2-671B,这是一款专为解决数学定理证明和形式化推理任务而设计的超大规模语言模型。目前,该模型已在 Hugging Face 上局部开放体验,并被 Novita 平台成功跑通,面向全球开发者和研究者开放测试。

最新在线体验地址

-

Novita 平台入口(推荐码可使用):https://novita.ai/referral?invited_code=A43LMN

-

Hugging Face 在线测试地址:https://huggingface.co/playground?modelId=deepseek-ai/DeepSeek-Prover-V2-671B&provider=novita

实测案例

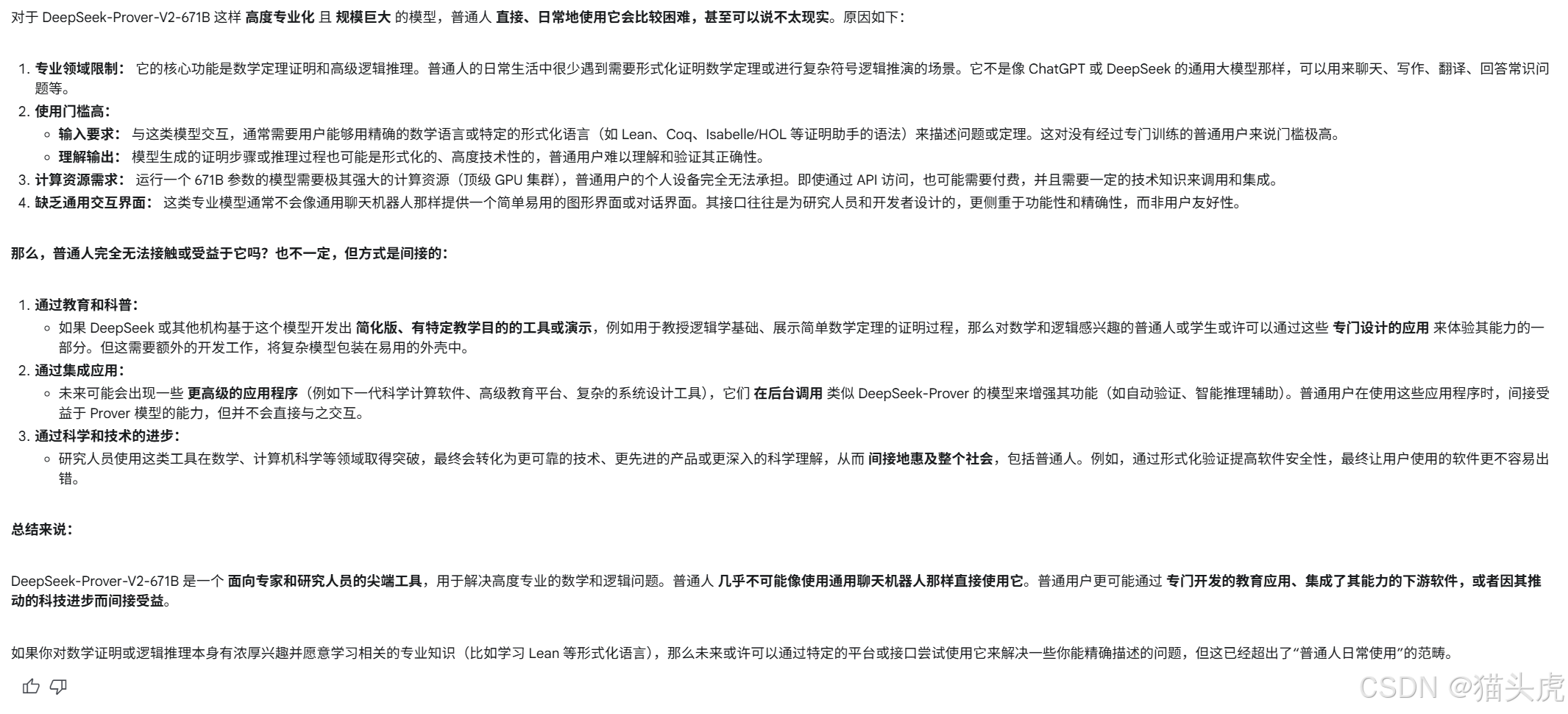

目标用户

模型概览

-

参数规模:约 6710 亿参数,划分为 163 个分片,每个分片大小约为 4.3GB,标志着其在开源领域中的顶级体量。

-

架构设计:构建于 DeepSeek-V3 框架之上,采用混合专家(Mixture of Experts, MoE)机制,共有 61 层 Transformer 层,隐藏维度为 7168。

-

上下文长度:支持高达 163,840 的最大上下文长度,可处理复杂的长链逻辑和多步骤数学推理。

-

量化技术:结合 FP8、BF16 与 F32 三种精度格式,兼顾模型推理速度与精度,提升部署灵活性。

-

模型格式:使用高效的

safetensors文件格式,加载性能良好,部署简便。

技术亮点

1. 数学推理优化

DeepSeek-Prover-V2-671B 被专门训练用于处理数学证明相关任务,包括自动化证明、逻辑推演、数学表达式解析等,在符号推理领域表现出色。

2. 高级训练方法

采用强化学习(如 RLHF)结合大规模数学合成数据进行微调,增强了模型在非结构化输入条件下的稳健性和泛化能力。

3. 专业领域能力突出

相比于通用大模型,Prover 版本具备更精准的逻辑组织能力和专业术语理解能力,特别适合在科研、教育、工程数学等场景中落地使用。

获取与使用

DeepSeek-Prover-V2-671B 可通过以下渠道体验或下载:

-

Hugging Face 模型主页:

https://huggingface.co/deepseek-ai/DeepSeek-Prover-V2-671B -

Novita 平台实时体验(推荐注册使用):

https://novita.ai/referral?invited_code=A43LMN

注意事项

请注意,DeepSeek-Prover-V2-671B 仅推荐用于专业级数学问题处理,对于通用对话、闲聊或非逻辑密集型任务,其表现可能不如通用大语言模型。

总结

DeepSeek-Prover-V2-671B 的发布标志着开源数学大模型领域的一次重大突破,其在数学推理精度、上下文处理能力和部署效率上的表现令人期待。对于追求专业、高效的数学自动证明能力的用户而言,这是一个不容错过的里程碑产品。

如需进一步了解部署方式、API 接入或定制化训练服务,欢迎留言或联系 DeepSeek 官方支持。

全生态接入系统技术白皮书)