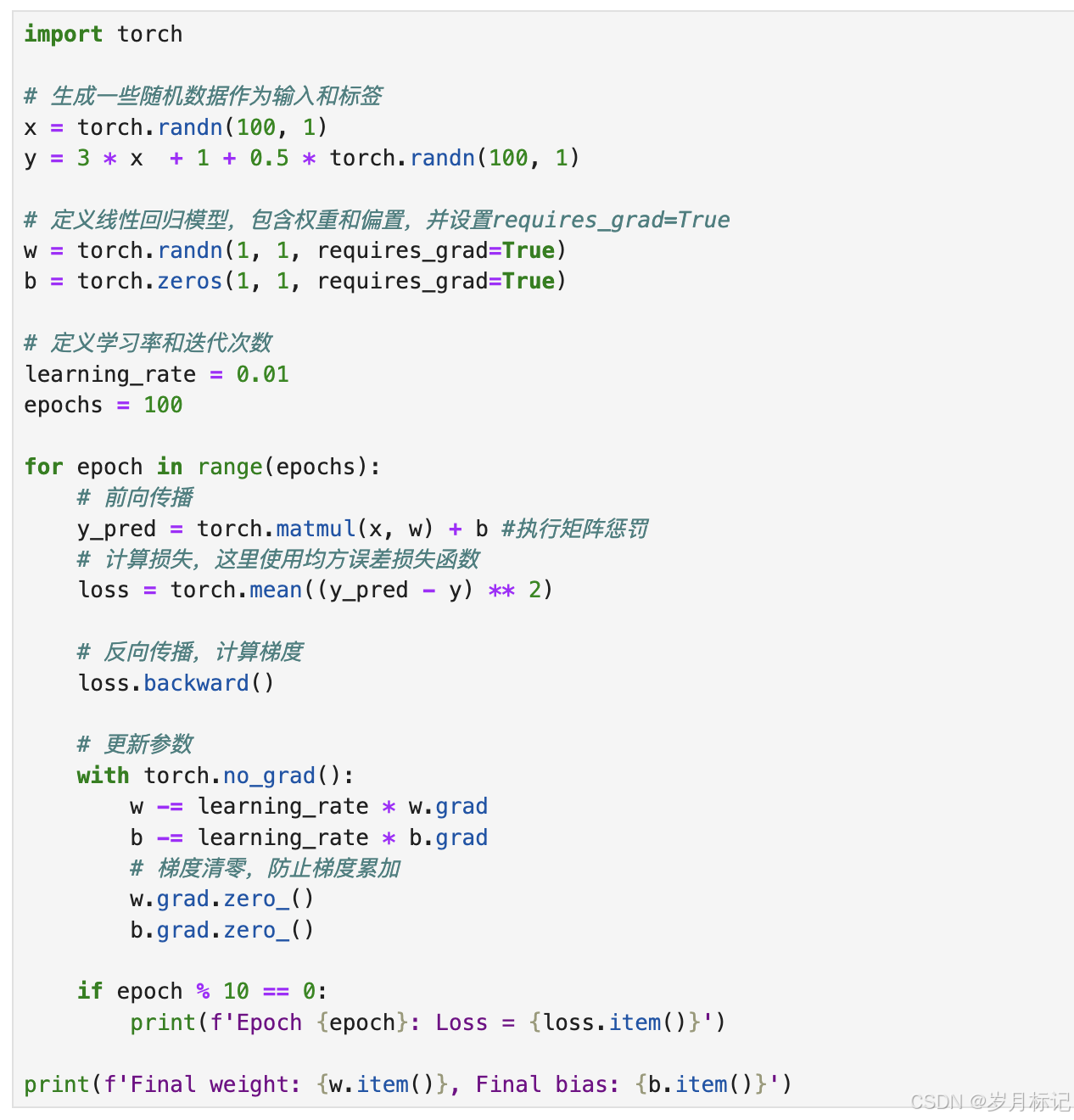

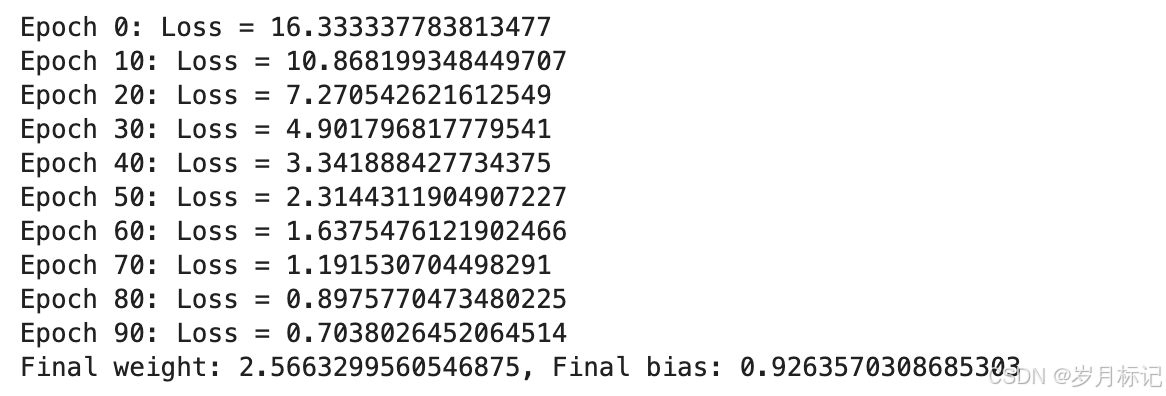

- 在训练过程中,通过循环进行多次迭代,每次迭代都进行前向传播计算预测值y_pred和损失loss,接着进行反向传播计算梯度,并根据梯度更新权重和偏置。

- 反向传播计算梯度的本质是损失函数对于模型各层参数的梯度。

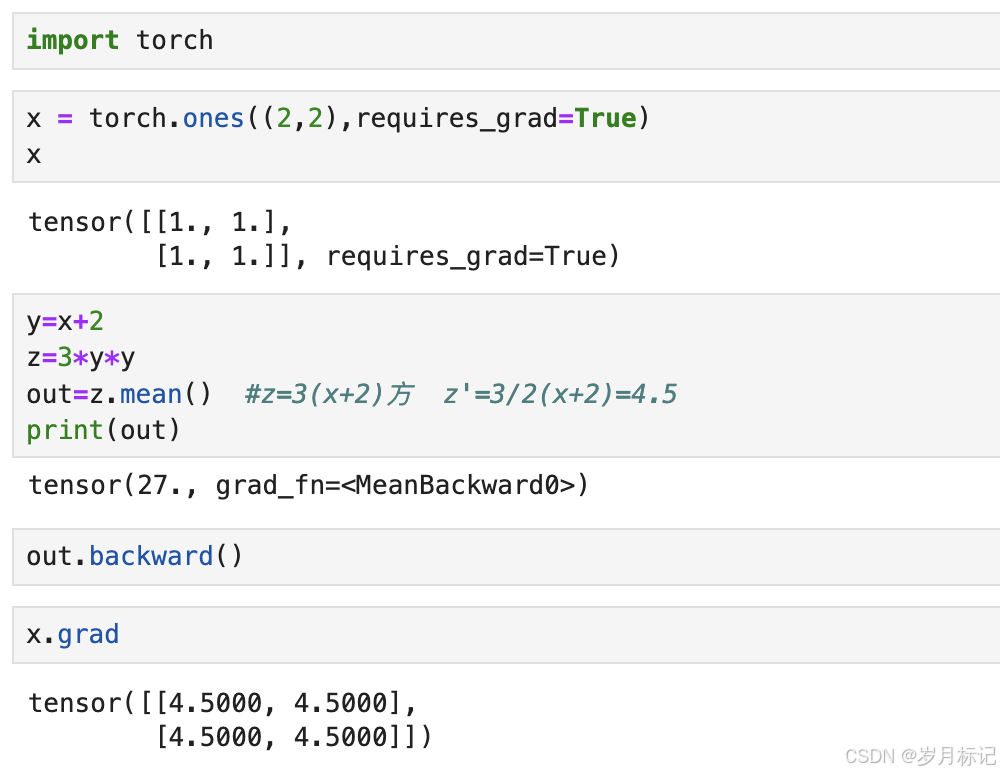

- requires_grad:张量的属性,设为True时,PyTorch会跟踪该张量的操作并计算梯度。如x = torch.tensor([1.0, 2.0, 3.0], requires_grad=True)。

- 以PyTorch为例,在前向传播时,它会自动记录对requires_grad=True的张量所进行的操作,当调用backward()函数时,就会触发反向传播,自动计算并填充这些张量的grad属性,即存储损失函数关于这些张量的梯度。

Case 1 计算梯度:

Case 2 线性回归:

全生态接入系统技术白皮书)