知识点回顾:

- resnet结构解析

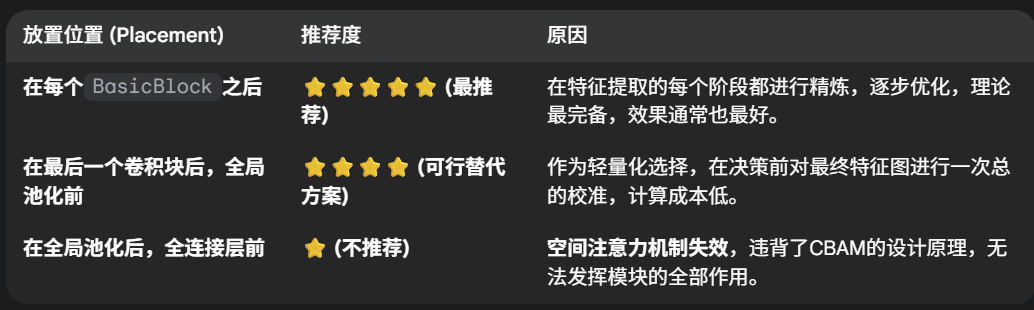

- CBAM放置位置的思考

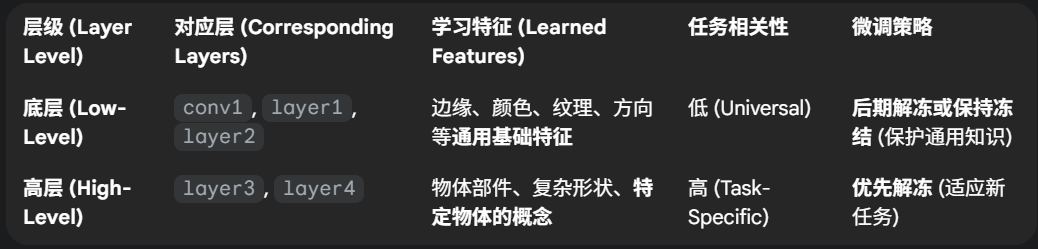

- 针对预训练模型的训练策略

- 差异化学习率

- 三阶段微调

ps:今日的代码训练时长较长,3080ti大概需要40min的训练时长

作业:

- 好好理解下resnet18的模型结构

- 尝试对vgg16+cbam进行微调策略

ResNet结构解析与CBAM微调策略

1.ResNet18核心结构

# ResNet18基础结构(基于torchvision实现)

from torchvision.models import resnet18

model = resnet18(pretrained=True)# 核心组件:

# - 初始卷积层(conv1): 7x7卷积+BN+ReLU

# - 4个layer结构(包含BasicBlock)

# - 平均池化层(avgpool)

# - 全连接层(fc)2.CBAM放置策略

class VGG16_CBAM(nn.Module):def __init__(self):super().__init__()self.features = nn.Sequential(# 第一个卷积块nn.Conv2d(3, 64, kernel_size=3, padding=1),CBAM(64), # 在卷积层后添加CBAMnn.ReLU(inplace=True),nn.Conv2d(64, 64, kernel_size=3, padding=1),CBAM(64), # 每个卷积块添加nn.ReLU(inplace=True),nn.MaxPool2d(kernel_size=2, stride=2)# ... 后续层同理)3.三阶段微调策略

# 阶段1:冻结特征层

for param in model.features.parameters():param.requires_grad = False# 阶段2:解冻后半部分层

for layer in list(model.features.children())[-4:]:for param in layer.parameters():param.requires_grad = True# 阶段3:全解冻+小学习率

optimizer = optim.SGD([{"params": model.features.parameters(), "lr": 1e-4},{"params": model.classifier.parameters(), "lr": 1e-3}

], momentum=0.9)作业

一、ResNet18结构理解 :

- 使用torchsummary查看详细结构

from torchsummary import summary

summary(resnet18().to("cuda"), (3, 224, 224))二、VGG16+CBAM微调 :

- 训练命令建议

python train.py --model vgg16_cbam --batch-size 64 --lr 1e-3 --freeze-epochs 5