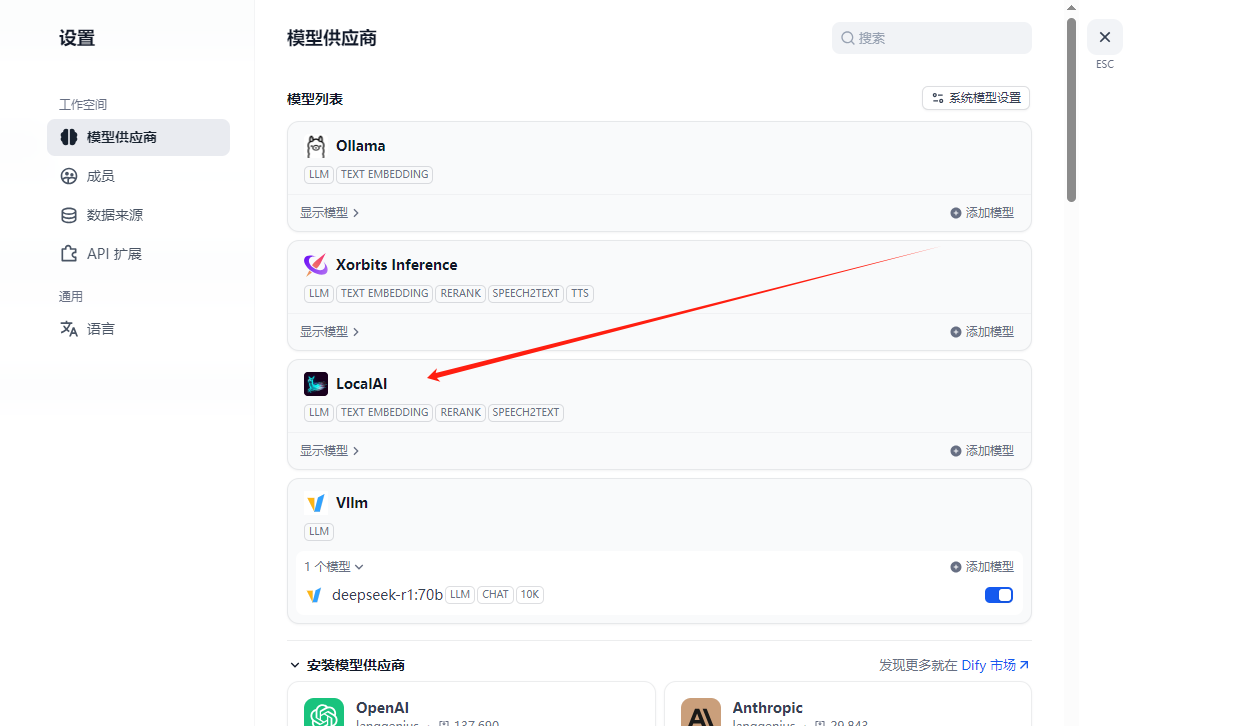

服务器使用vllm运行大模型,今天在Dify中使用插件LocalAI配置模型供应商后,使用工作流的时候,报错:“Run failed: PluginInvokeError: {"args":{},"error_type":"ValueError","message":"User message content must be str"}”

场景:上传文件后,然后再次提问机会出现错误如下:

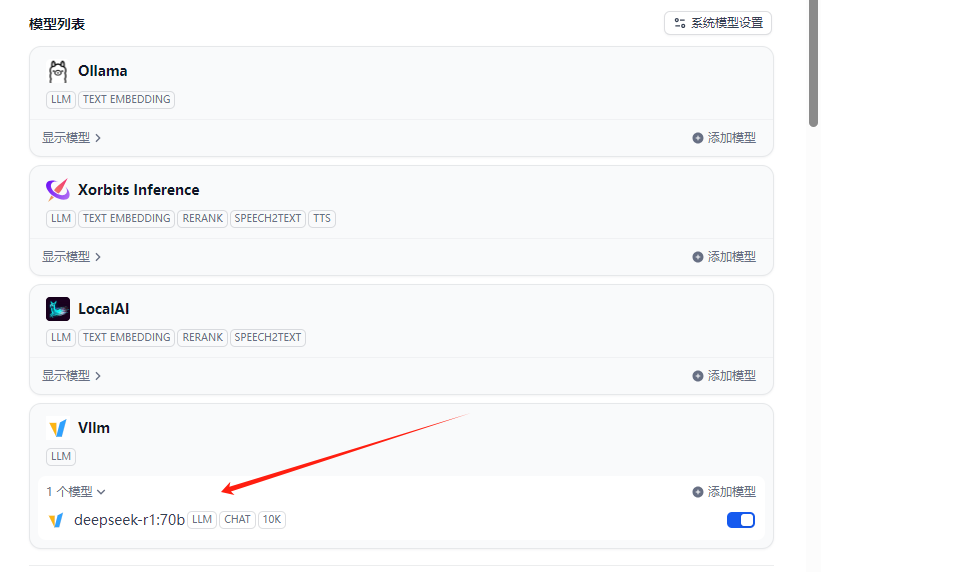

刚开始怀疑是模型参数之类的问题,但是用ollama配置的模型就不会报错。原因不明。于是改成使用Vllm插件重新添加模型供应商。

然后又可以开心的玩耍了。

、地图打印(webprinting)等服务)

——日期类和const成员函数)