一.逻辑回归的由来

逻辑回归不是一个回归的算法,不是用来做预测的,逻辑回归是一个分类的算法,那为什么不叫逻辑分类?因为逻辑回归算法是基于多元线性回归的算法(多元线性回归:y=w0x0+w1x1+.....+wnxn)。正因为此,逻辑回归这个分类算法是线性的分类器。

二.Sigmoid函数

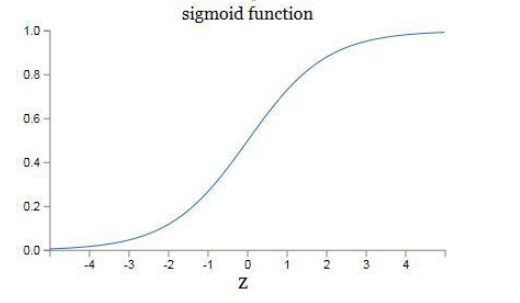

1.图像

可以注意到,当自变量等于0的时候,因变量为0.5,且值域为[0,1],这个特性可以满足概率的取值。

2.作用

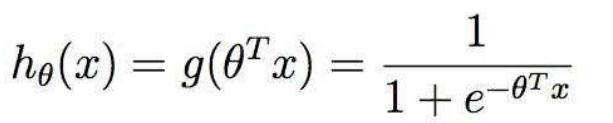

简单来说,就是在多元线性回归的基础上,将得到的y_hat作为Sigmoid函数的输入得到最终的概率值。

我们知道,作为一个二分类分类器,就是要找到分界,也就是输出等于0.5为分界,我们要找到的就是y_hat = 0.5,根据表达式我们可以知道,也就是找到输入等于0时,θ的值,注意这个θ是由多个w的矩阵。

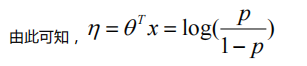

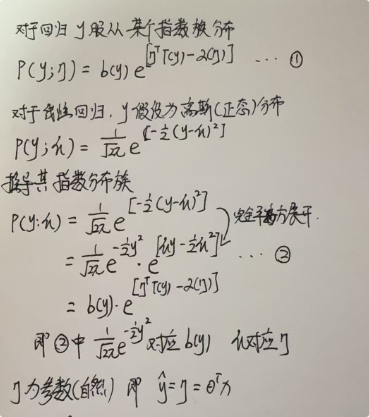

3.推导

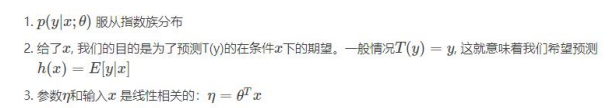

广义线性回归:

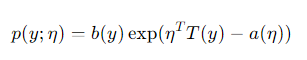

指数族分布:

有高斯分布、二项分布、伯努利分布、泊松分布、指数分布等。对于回归来说,如果y是服从某个指数族分布,那么我们就可以广义线性回归来建模。我们在简单的线性回归中,y就是满足了高斯分布/正态分布。

推导:

这样我们就得到了Sigmod函数。

补充:我们可以由此推导线性回归

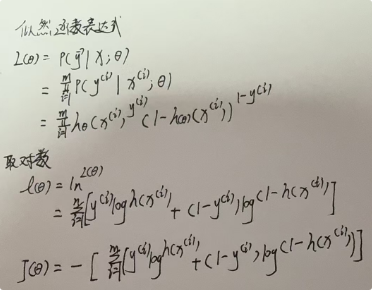

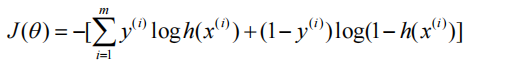

三.损失函数交叉熵

![]()

或

![]()

得到损失函数

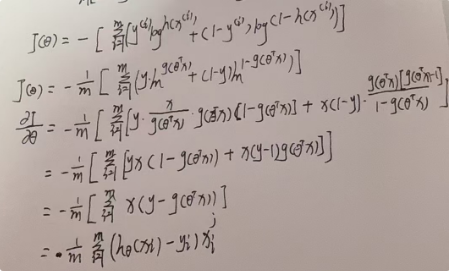

损失函数求导

首先对sigmod函数求导

J对θ求偏导:

)

感知机)